Theo BGR, năm 2024 sẽ là khoảng thời gian bản lề để thế giới nhận ra trí tuệ nhân tạo có thực sự là tương lai của ngành điện toán hay chỉ là một cơn sốt nhất thời. Trong khi những ứng dụng thực thụ của AI ngày càng đa dạng, thì mặt trái của công nghệ này cũng sẽ lộ diện qua vô số chiêu trò lừa đảo trong những tháng tới.

Các chuyên gia chống lừa đảo tại Scams.info vừa đưa ra danh sách 3 chiêu trò lừa đảo lợi dụng công nghệ AI mà mọi người cần đề cao cảnh giác trong năm 2024. Nguyên tắc chung là hãy cẩn thận trước những gì được mô tả quá hào nhoáng, nhưng những thủ đoạn dưới đây đòi hỏi phải có sự đề cao cảnh giác đặc biệt.

Lừa đảo đầu tư với AI

Các ông lớn như Google, Microsoft và OpenAI đã rót hàng triệu USD vào AI và sẽ tiếp tục đầu tư mạnh hơn trong năm nay. Những kẻ lừa đảo sẽ lợi dụng thực tế này để dụ dỗ bạn đầu tư vào những cơ hội mờ ám. Nếu ai đó trên mạng xã hội cố thuyết phục rằng AI sẽ tăng gấp bội lợi nhuận đầu tư, hãy suy nghĩ kỹ trước khi mở ví.

Những khoản đầu tư 'hời' và ít rủi ro không bao giờ có thực

AFP

"Hãy cẩn thận với những khoản đầu tư hứa hẹn lợi nhuận cao với rủi ro thấp và chắc chắn phải nghiên cứu kỹ lưỡng trước khi dốc tiền cho chúng", chuyên gia Nicholas Crouch từ Scams.info cảnh báo. Những nhà đầu tư mới bước vào nghề cũng nên cảnh giác với những khoản lợi khi được yêu cầu giới thiệu thêm người tham gia đầu tư; chúng thường hoạt động theo mô hình đa cấp, vốn chỉ mang lại lợi ích cho những người đứng đầu, còn những người tham gia khác rất hiếm khi được hưởng lợi.

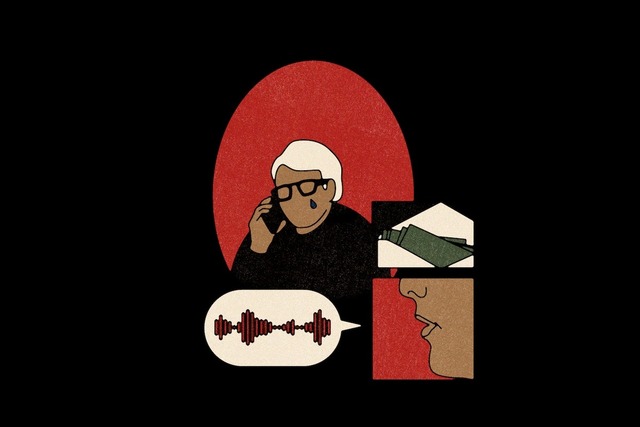

Mạo danh người thân

Chiêu trò giả danh thành bạn bè hoặc người thân để mượn tiền không còn mới, khi việc kẻ lừa đảo giả giọng không thực sự hiệu quả. Tuy nhiên, với AI, trò lừa đảo này sẽ trở nên đáng sợ hơn rất nhiều. Chỉ cần một video YouTube hoặc bài đăng Facebook có giọng nói của người thân, kẻ lừa đảo có thể dùng AI để sao chép một cách hoàn hảo. Liệu bạn có thể nhận ra sự khác biệt qua cuộc gọi điện thoại?

AI có thể dễ dàng giả giọng người thân của bạn

Chụp màn hình Washington Post

"Điều quan trọng là mọi người phải bảo vệ tài khoản mạng xã hội của mình để ngăn kẻ lừa đảo thu thập được giọng nói và thông tin về gia đình", Crouch nhấn mạnh.

Dùng giọng nói để qua mặt hệ thống bảo mật

Một số ngân hàng sử dụng nhận dạng giọng nói để xác minh người dùng khi giao dịch qua điện thoại. Vì những lý do đã nêu ở trên, phương thức này bỗng trở nên kém an toàn hơn so với trước đây. Nếu bạn đăng video hoặc clip có giọng nói của mình ở bất kỳ đâu trên internet, kẻ xấu có thể sử dụng những nội dung đó để sao chép giọng nói của bạn. Như Crouch lưu ý, các ngân hàng vẫn có các dữ liệu khác để xác minh danh tính của khách hàng, nhưng chiêu trò này đang khiến kẻ gian tiến gần hơn đến việc đánh cắp tài khoản ngân hàng của bạn.

Hệ thống bảo mật bằng giọng nói đã không còn an toàn trước sức mạnh của AI

Chụp màn hình SHAIP

AI có thể thay đổi căn bản cuộc sống của chúng ta và cách chúng ta tương tác với các thiết bị. Nó cũng là công cụ mới nhất mà tin tặc và kẻ lừa đảo sẽ sử dụng để tấn công người dùng. Vì thế luôn phải cảnh giác và luôn nghiên cứu kỹ trước khi tham gia bất cứ hoạt động nào liên quan đến AI.

Bình luận (0)